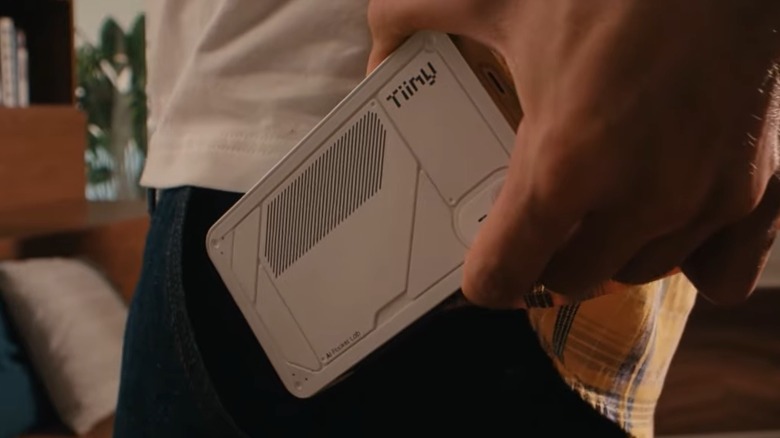

슈퍼컴퓨터를 생각해 보면 에어컨이 완비되어 있고 하드웨어가 가득 차고 수십 마일에 달하는 데이터 케이블로 장식된 대규모 시설을 생각할 가능성이 높습니다. 그러나 미국 스타트업인 Tiiny AI는 실제로 창고 규모의 시설이 필요하지 않은 슈퍼컴퓨터를 만들었다고 주장합니다. 주머니에 쏙 들어가는 슈퍼컴퓨터입니다.

문제의 장치인 AI Pocket Lab을 살펴보기 전에 이러한 컴퓨터가 어떻게 “슈퍼컴퓨터”라고 불릴 수 있는지 살펴보겠습니다. 슈퍼컴퓨터에 대한 엄격한 정의는 없지만 일반적으로 현재 작동 중인 가장 크고 가장 강력한 컴퓨터를 설명하는 데 사용됩니다. 즉, 기존 소비자 하드웨어의 기능을 넘어서는 작업 부하를 처리할 수 있는 시스템입니다.

이러한 맥락에서 구별은 규모보다는 역량에 따라 결정됩니다. 이는 일반적으로 최소한 여러 GPU가 필요하지만 데이터 센터 인프라가 필요한 경우가 많은 워크로드인 대규모 언어 모델을 로컬에서 실행하도록 설계된 장치입니다. 여기서 이 장치가 “박사 수준” AI를 주머니에 넣을 수 있다고 주장한다는 사실은 확실히 소비자 하드웨어의 기능을 넘어서는 것입니다. 따라서 하드웨어는 여러분이 상상했던 슈퍼컴퓨터와는 전혀 같지 않을 수도 있지만, 하드웨어가 수행할 수 있는 작업 유형은 일반적으로 슈퍼컴퓨터를 정의하는 데 허용되는 한 가지 기준을 충족할 것입니다.

자, 슈퍼컴퓨터 정의는 끝났습니다. 박사 수준 AI를 휴대할 수 있는 장치를 살펴보겠습니다.

AI 포켓랩 안에는 무엇이 있나요?

AI Pocket Lab의 비결은 원시 처리 능력보다 메모리를 우선시하는 특이한 하드웨어 조합입니다. Tiiny AI는 이 장치를 12코어 ARM 프로세서와 80GB의 LPDDR5X RAM을 결합한 것으로 나열합니다. 그 중 약 48GB는 AI 워크로드를 처리하도록 특별히 설계된 전용 신경 처리 장치(NPU)용으로 예약되어 있습니다.

시스템이 1,200억 매개변수 범위의 LLM을 포함하여 로컬로 LLM을 실행할 수 있도록 하는 것이 바로 이 구성입니다. 또한 이 회사는 프로세서와 NPU 시스템 전반에 걸쳐 초당 최대 190조 개의 TOPS(초당 작업) 작업 성능과 초당 18~40개 토큰의 출력 속도를 보고합니다. 일반적으로 대부분의 LLM에서는 4개의 토큰이 3개의 단어와 동일합니다. 따라서 이를 통해 기계는 실용적인 장치가 될 만큼 빠르게 출력을 생성할 수 있습니다.

기타 사양으로는 1TB PCIe 4.0 SSD, Wi-Fi 및 Bluetooth, USB-C 포트 3개, 통합 마이크가 있습니다. 이것이 독립형 컴퓨터가 아니라는 점은 주목할 가치가 있습니다. 대신, Linux는 전용 클라이언트 없이 지원되지만 Windows 또는 macOS 호스트 시스템에 직접 연결되거나 네트워크를 통해 액세스할 수도 있습니다. 개발자들은 50개 이상의 오픈 소스 LLM을 지원한다고 주장합니다.

이는 충분히 놀라운 일이지만 여기서 잠시 멈춰 이 모든 것이 주머니에 쏙 들어가는 장치에서 나온 것이며 전력을 많이 소모하는 데이터 센터에 액세스할 필요가 없다는 점을 기억할 가치가 있습니다. 크기는 5.6인치 x 3.15인치, 두께는 1인치 미만, 무게는 10.5온스로 스마트폰 수준입니다.

로컬 AI가 중요한 이유

이 시점에서 제기할 수 있는 좋은 질문은 ‘왜 이 기계가 존재하는가?’입니다. 결국, 우리는 이제 모든 스마트폰에서 사용할 수 있는 AI 비서와 함께 고도로 상호 연결된 세상에 살고 있습니다. iPhone에서 AI 챗봇을 로컬로 실행할 수도 있습니다.

AI Pocket Lab의 가장 중요한 측면 중 하나는 클라우드 인프라에 의존하지 않고도 AI 모델을 실행할 수 있다는 점입니다. 개인 정보 보호 관점에서 볼 때 이는 중요합니다. 온라인 AI 도구는 오랫동안 우려의 역사를 갖고 있기 때문에 온라인 AI 챗봇과 개인정보를 공유하지 않는 데에는 충분한 이유가 있습니다. 또 다른 관심 포인트는 연결이 제한되거나 없는 환경에서 사용자가 AI에 액세스할 수 있도록 하는 기능입니다.

Tiiny 장치와 일반적인 스마트폰에서 로컬로 AI 챗봇을 실행하는 것 사이의 큰 차이점은 처리할 수 있는 AI 모델의 크기입니다. AI Pocket Lab은 최대 1,200억 개의 매개변수가 포함된 모델을 처리할 수 있습니다. 반면 Llama 3.1과 같은 일반적인 오프라인 챗봇은 약 80억 개의 매개변수를 처리할 수 있습니다.

AI Pocket Lab은 또한 앞서 언급한 전기를 많이 소비하는 데이터 센터가 아닌 데이터가 생성된 장소에 더 가까운 곳에서 데이터가 처리되는 엣지 컴퓨팅을 향한 점점 더 많은 노력을 반영합니다. 맥락에 따라 AI Pocket Lab은 65와트 전원 공급 장치와 함께 제공되며 정격 TDP는 30와트입니다. 이는 대규모 AI 인프라보다 일반적인 노트북에 훨씬 더 가까운 수치입니다.